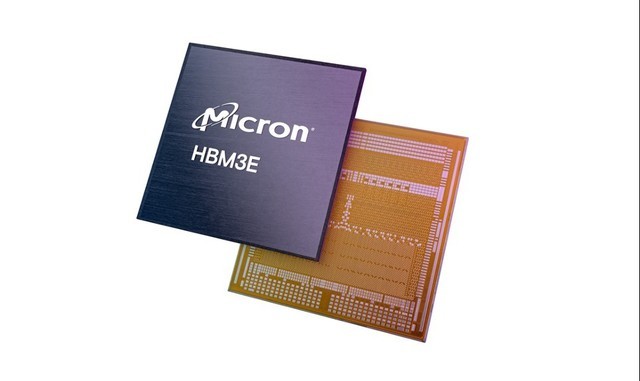

近日,Micron Technology宣布已开始量产其HBM3E高带宽内存解决方案。英伟达H200 Tensor Core GPU将采用美光8层堆叠的24GB容量HBM3E内存,并于2024年第二季度开始出货。美光通过这一里程碑式进展持续保持行业领先地位,并且凭借HBM3E的性能和能效为人工智能(AI)解决方案赋能。

美光HBM3E比竞品功耗低30%,助力数据中心降低运营成本

HBM3E:推动人工智能革命

随着人工智能需求的持续激增,内存解决方案对于满足工作负载需求的增加至关重要。美光HBM3E解决方案通过以下优势直面这一挑战:

· 性能:美光HBM3E引脚速率超过9.2Gb/s,提供超过1.2TB/s的内存带宽,助力人工智能加速器、超级计算机和数据中心实现超高速的数据访问。

· 能效:美光HBM3E功耗比竞品低约30%,处于行业领先地位。为支持日益增长的人工智能需求和用例,HBM3E以更低功耗提供更大吞吐量,从而改善数据中心的主要运营支出指标。

· 可扩展性:美光HBM3E目前提供24GB容量,使数据中心能够无缝扩展其人工智能应用。无论是用于训练海量神经网络还是加速推理任务,美光的解决方案都提供了必要的内存带宽。

美光执行副总裁暨首席商务官Sumit Sadana表示:“美光凭借HBM3E这一里程碑式产品取得了三大成就:领先业界的上市时间、引领行业的性能和出众的能效表现。人工智能工作负载在很大程度上依赖于内存带宽和容量。美光拥有业界领先的HBM3E和HBM4产品路线图,以及为AI应用打造的DRAM和NAND全套解决方案,为助力人工智能未来的大幅增长做足了准备。”

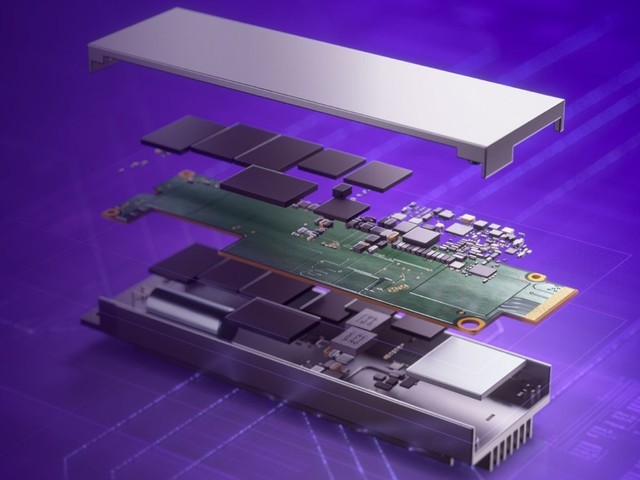

美光利用其1β(1-beta)技术、先进的硅通孔(TSV)和其他实现差异化封装解决方案的创新技术开发出业界领先的HBM3E设计。美光作为2.5D/3D堆叠和先进封装技术领域长久以来的存储领导厂商,有幸成为台积电 3Dfabric联盟的合作伙伴成员,共同构建半导体和系统创新的未来。

美光将于2024年3月出样12层堆叠的36GB容量HBM3E,提供超过1.2TB/s的性能和领先于竞品的卓越能效,从而进一步强化领先地位。美光将赞助3月18日开幕的英伟达GTC全球人工智能大会,届时将分享更多前沿AI内存产品系列和路线图。

本文属于原创文章,如若转载,请注明来源:美光开始量产HBM3E解决方案,加速人工智能发展https://stor.zol.com.cn/858/8587281.html